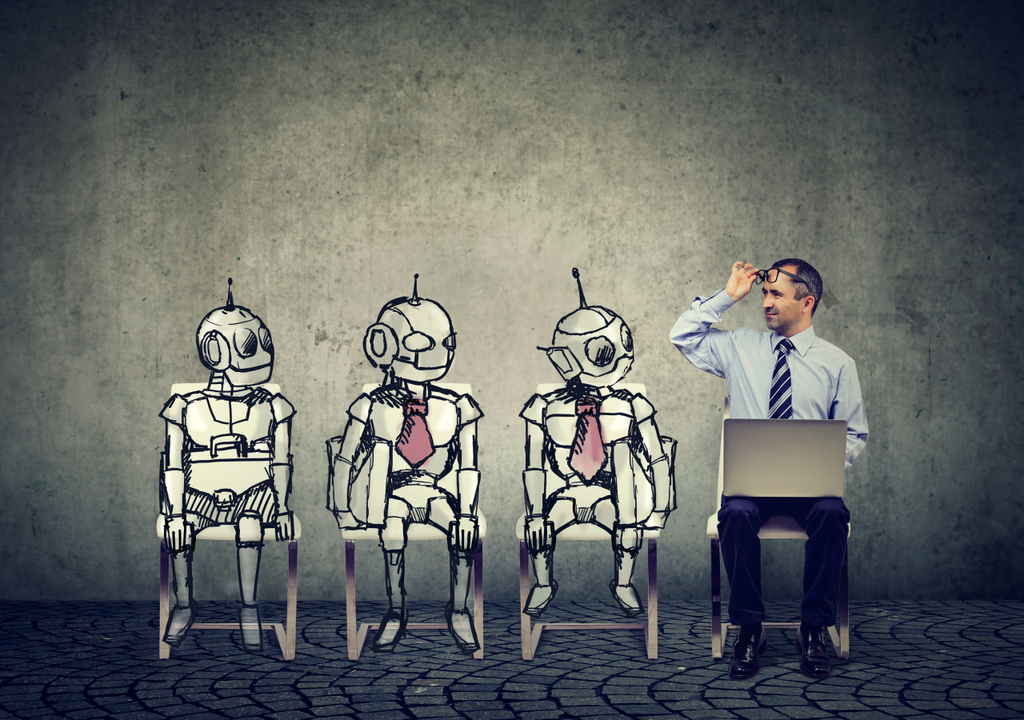

Por que as coisas geradas por IA sempre parecem mais do mesmo?

A impressão quando vemos algo gerado por inteligência artificial é que já vimos aquilo antes. Isso acontece por algo que está por trás de quase todas ferramentas hoje.

Quando você olha alguma coisa criada por inteligência artificial, seja uma imagem ou texto, a impressão é que você já viu aquilo antes. As imagens não parecem originais e os textos parecem vários outros textos. A falta de criatividade nas coisas geradas por inteligência artificial é um debate constante nas redes sociais e em matérias.

O motivo dessa impressão é o próprio pilar de como essas ferramentas são criadas e como são treinadas. O aprendizado de máquina - ou machine learning - é o segredo por trás de quase todos os modelos atuais e ao mesmo tempo traz uma limitação nos resultados. Durante o aprendizado de máquina, o modelo aprende através de observação de padrões em dados que foram alimentados.

Como os dados alimentados geralmente foram criados por humanos, o modelo só consegue aprender os padrões e relações entre coisas que já existem. Recentemente, uma discussão sobre o uso de dados de artistas cresceu e levantou pontos importantes. A discussão mostra que o uso de aprendizado de máquina na inteligência artificial generativa pode ser o problema por traz dessas questões.

IA x IA Generativa

Desde que o ChatGPT ganhou popularidade, a inteligência artificial generativa tem sido o tópico mais debatido dentro da comunidade de inteligência artificial. As grandes empresas de tecnologia tem focado recursos e investimentos na área de inteligência artificial generativa. A popularidade ficou tão grande que é comum que inteligência artificial e inteligência artificial generativa sejam confundidas.

Dentro da inteligência artificial, há outras áreas como preditiva, de classificação, de regressão e entre outras. Cada área possui objetivos diferentes e a parte de geração de dados, incluída na generativa, é apenas uma de várias aplicações. Recentemente, o potencial da generativa aumentou consideravelmente com a introdução das transformers.

Aprendizado de máquina

Algo em comum em quase todas as áreas é o uso do aprendizado de máquina. O aprendizado de máquina se refere à um conjunto de técnicas que uma máquina aprende através de observação de padrões. A ideia é alimentar uma grande quantidade de dados para um modelo que aprenderá a identificar padrões e relações entre os dados.

Dois tipos de aprendizados são comuns: o supervisionado e o não-supervisionado. O supervisionado se refere quando há uma entrada e uma saída com a resposta, a máquina aprende a relação da entrada com a saída através de uma função. O não-supervisionado se refere quando a máquina recebe dados de entrada e aprende relações por contra própria.

Como inteligência artificial generativa aprende?

No caso da inteligência artificial, pode ocorrer uma combinação de ambos tipos de aprendizado e até mesmo de um chamado semi-supervisionado. Algumas técnicas de aprendizado de inteligência artificial generativa depende de observar padrões e reconstruir esses padrões, como rostos humanos. Uma dessas técnicas são as redes neurais generativas (GANs).

Em 2017, a Google introduziu as camadas de atenção juntamente com as transformers. A ideia é que durante essa observação de padrões, camadas de atenção seriam usadas para priorizar regiões importantes em uma imagem ou texto. Alguns tipos de transformers aprendem através de supervisionado como alguns tipos de tradutores, já outros podem apresentar uma mistura de métodos.

Por que tudo parece mais do mesmo?

Como o aprendizado de máquina é a técnica mais utilizada nas ferramentas atuais, elas aprendem através de dados já pré-existentes. Textos, imagens, vídeos que elas já observaram durante o processo de treinamento. Com isso, esses modelos aprendem padrões que já são conhecidos e faz relação entre eles para criar algo.

Como elas se baseiam nesses padrões conhecidos, é natural que coisas geradas por inteligência artificial não pareçam originais. Essa é uma crítica constante de muitas pessoas e o motivo é que o próprio método de aprendizado limita a criação de coisas novas. Atualmente é possível apenas criar e fazer relações com coisas já existentes.

Polêmica

Uma das principais críticas é sobre a questão de direitos autorais visto que muitas dessas ferramentas treinam e aprendem com dados obtidos na internet. Esses dados muitas vezes de arte feita por artistas que serão usadas para um modelo reproduzir o estilo daquele artista. Dessa forma, a ferramenta não estaria criando algo e apenas copiando o estilo.

Isso também é conectado com a própria limitação de que as ferramentas não conseguem criar algo original e muitas vezes o estilo é a cópia de artistas. Atualmente, o debate sobre direitos autorais em imagens disponíveis na internet. Outro ponto é que sem a arte humana, essas ferramentas atingem um limite já que não são capazes de criar algo novo.